jaká je konvoluční Architektura neuronové sítě ?

tento článek byl publikován jako součást dat Science Blogathon.

Úvod

Práce na Projektu rozpoznávání obrazu nebo Detekce Objektů, ale neměl základy vybudovat architekturu?,

V tomto článku se budeme vidět, co jsou konvoluční neuronové sítě, architektury, od základních a budeme mít základní architektura jako případová studie aplikovat naše poznatky, jedinou podmínkou je, jen musíte vědět, jak konvoluce funguje, Ale nebojte je to velmi jednoduché !!

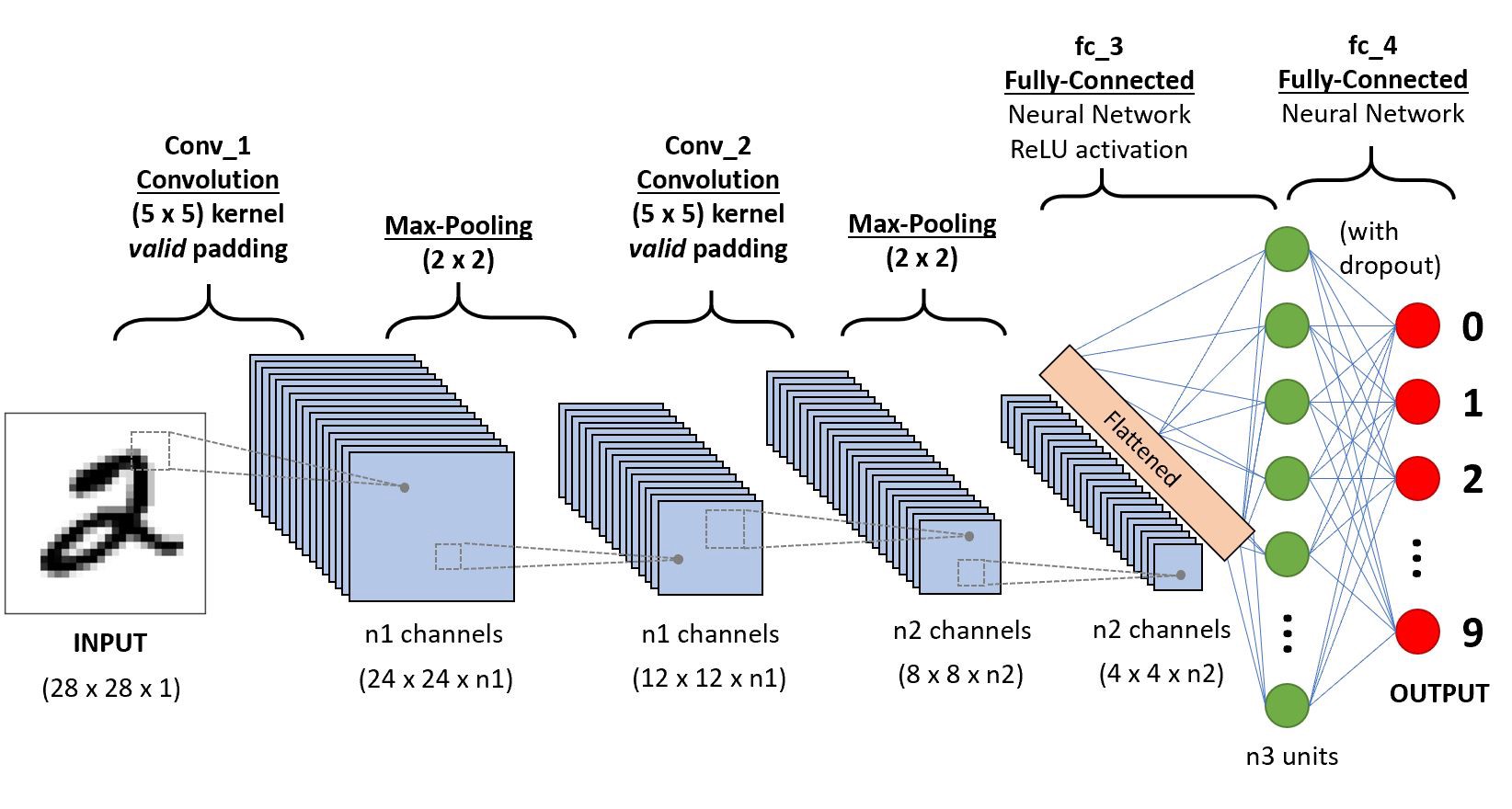

vezměme si jednoduchý Konvoluční neuronové sítě,

půjdeme vrstva-moudré, aby si hluboké poznatky o tom CNN.,

za Prvé, existuje několik věcí, učit se od vrstvy 1, které je kráčející a polstrování, uvidíme, každé z nich v krátkosti s příklady

předpokládejme, že tohle ve vstupní matici 5×5 a filtr matice 3X3, pro ty, kteří nevědí, co filtr je sada závaží v matice aplikovaná na obrázek nebo matice k získání požadované vlastnosti, prosím, vyhledávání na konvoluční pokud je to váš první čas!

Poznámka: Při konvoluci vždy vezmeme součet nebo průměr všech hodnot.,

filtr může mít libovolnou hloubku, pokud má filtr hloubku d, může jít do hloubky d vrstev a konvolute i.,“f4a6da248a“>

Zde vstup je o velikosti 5×5 po použití 3×3 jádra nebo filtrů, můžete získat 3×3 funkce výstupu mapě, takže pokusme se formulovat to,

.png)

výstup výšky je formulována a to samé s o/p šířka také…

Polstrování

Při použití závitů nebudeme-li získat výstup, rozměry stejné jako vstup budeme ztrátě dat přes hranice, takže jsme se připojit na hranici nuly a přepočítat konvoluce zahrnuje všechny vstupní hodnoty.,r šířka také

Kráčející

někdy nechceme, aby zachytit všechny údaje nebo informace k dispozici, takže jsme vynechat některé sousední buňky, pojďme si to představit,

vstupní matice nebo obraz je o rozměrech 5×5 s filtrem, 3×3 a kroku 2, takže pokaždé, když jsme se přeskočit dva sloupce a konvolut, pojďme formulovat to,

.png)

v Případě, že rozměry jsou v plováku můžete vzít ceil() na výstup.,e (další blízké celé číslo)

zde H odkazuje na výšku, takže výstupní výška je formulována a stejná s šířkou o / p také a zde 2 je Hodnota kroku, takže ji můžete vytvořit jako s ve vzorcích.

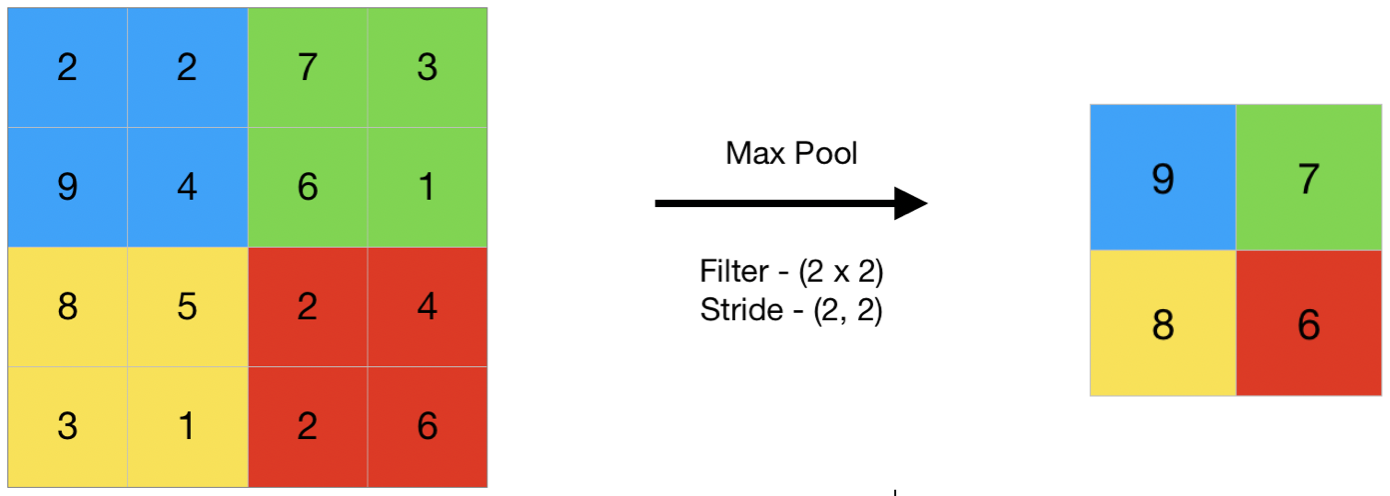

Sdílení

V obecné rovině sdružování se vztahuje na malé části, takže tady jsme si malou část vstupního a pokusit se vzít průměrná hodnota uvedená jako průměrná sdružování nebo se maximální hodnota nazývá jako max sdružování, takže tím sdružování na obrázku nebereme všechny hodnoty bereme souhrnné hodnotě přes všechny hodnoty dárek !!!,

tady je příklad max sdružování takže tady přičemž krok dva bereme maximální hodnoty přítomny v matrix

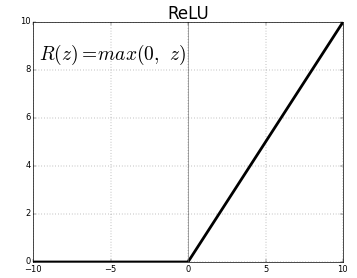

Aktivace funkce

Aktivace funkce je uzel, který je uveden na konci nebo mezi Neuronové Sítě. Pomáhají rozhodnout, zda neuron vystřelí nebo ne., Máme různé typy aktivační funkce stejně jako na obrázku výše, ale pro tento post, mé zaměření bude na Opraveny Lineární Jednotky (ReLU)

neklesají své čelisti, to není tak složité tato funkce jednoduše vrací 0 pokud je vaše hodnota je negativní, ještě to vrátí stejnou hodnotu, kterou jste dal, nic, ale eliminuje negativní výstupy a udržuje hodnoty mezi 0 až +nekonečno.

Nyní, že jsme se naučili všechny základy, potřeba, dejte nám studovat základní neuronová síť tzv. LeNet.,

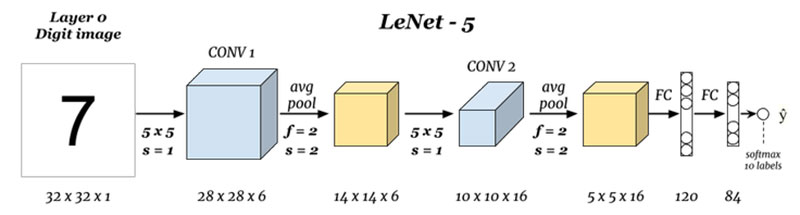

LeNet-5

před spuštěním uvidíme, jaké jsou dosud navržené architektury.,ures

Jaké jsou vstupy a výstupy (Vrstva 0 a Vrstvy N) :

Tady jsme předpovídají číslic na základě vstupního obrazu vzhledem, všimněte si, že obraz je o rozměrech výška = 32 pixelů, šířka = 32 pixelů, a hloubku 1, takže můžeme předpokládat, že to je obrázek ve stupních šedi nebo černé a bílé, udržování, že v mysli výstup je softmax všech 10 hodnot, zde softmax dává pravděpodobnosti nebo poměry pro všech 10 číslic, můžeme vzít číslo jako výstup s nejvyšší pravděpodobnosti, nebo poměr.,ef5″>

Tady jsme se s vstupní a convoluting s filtry o velikosti 5 x 5 a tím produkuje výstup o velikosti 28 x 28 kontrola výše uvedeného vzorce pro výpočet výstupní rozměry, věc tady je, že jsme přijali 6, jako filtry a proto se hloubka conv1 je 6, proto se jeho rozměry byly, 28 x 28 x 6 nyní předat toto sdružování vrstvu

Sdružování 1 (Layer 2) :

.png)

Tady jsme se s 28 x 28 x 6 jako vstup a použití průměru sdružování matice 2×2 a kroku 2 jsem.,e vznášející 2 x 2 matice na vstupu a vezmeme průměr všech těch čtyř pixelů a skákání se skip, 2 sloupce pokaždé, čímž dává 14 x 14 x 6 jako výstupní jsme computing sdílení pro každou vrstvu, takže sem výstupní hloubka je 6.

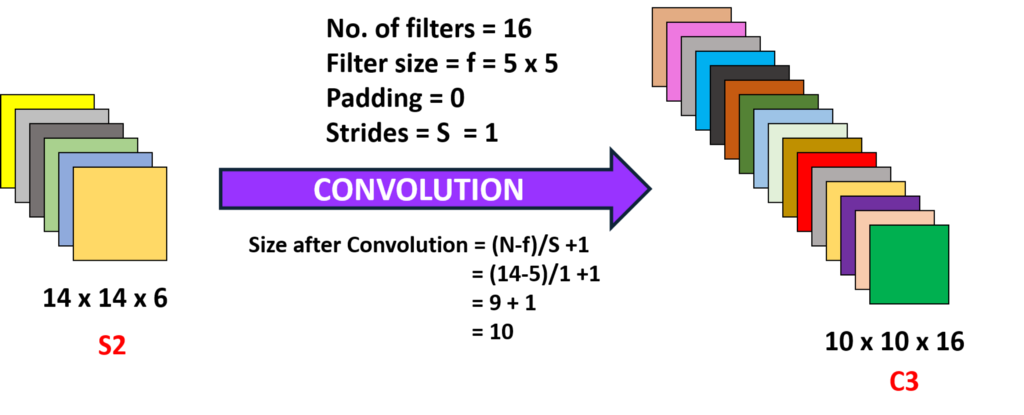

Konvoluce 2 (Layer 3) :

Tady bereme 14 x 14 x 6 jsem.e předchozí o/p a convoluting s filtrem o velikosti 5 x5, s krokem 1 jsem.,e (ne přeskočit), a s nulovou výplně a tak jsme si 10 x 10 výstup, teď tady jsme se s 16 tyto filtry hloubky 6 a convoluting tedy získání výstupu 10 x 10 x 16

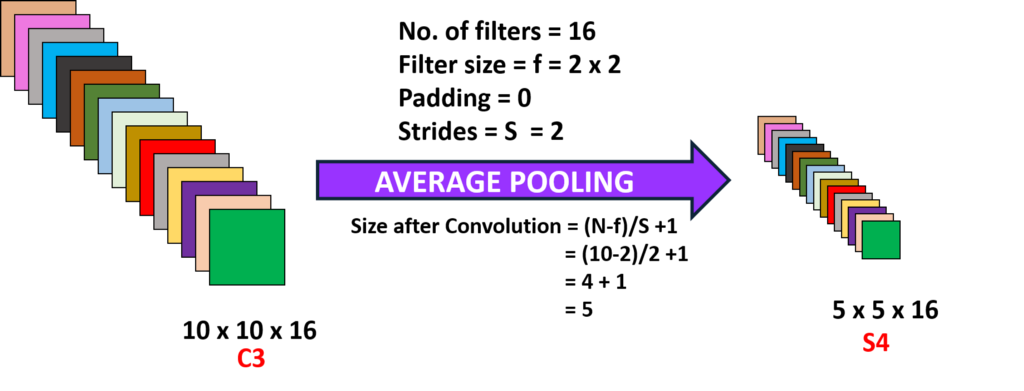

Sloučení 2 (Vrstva 4):

Tady jsme se s výstup z předchozí vrstvy a provedení průměr sdružování s krokem 2 jsem.,yer (N-1) :

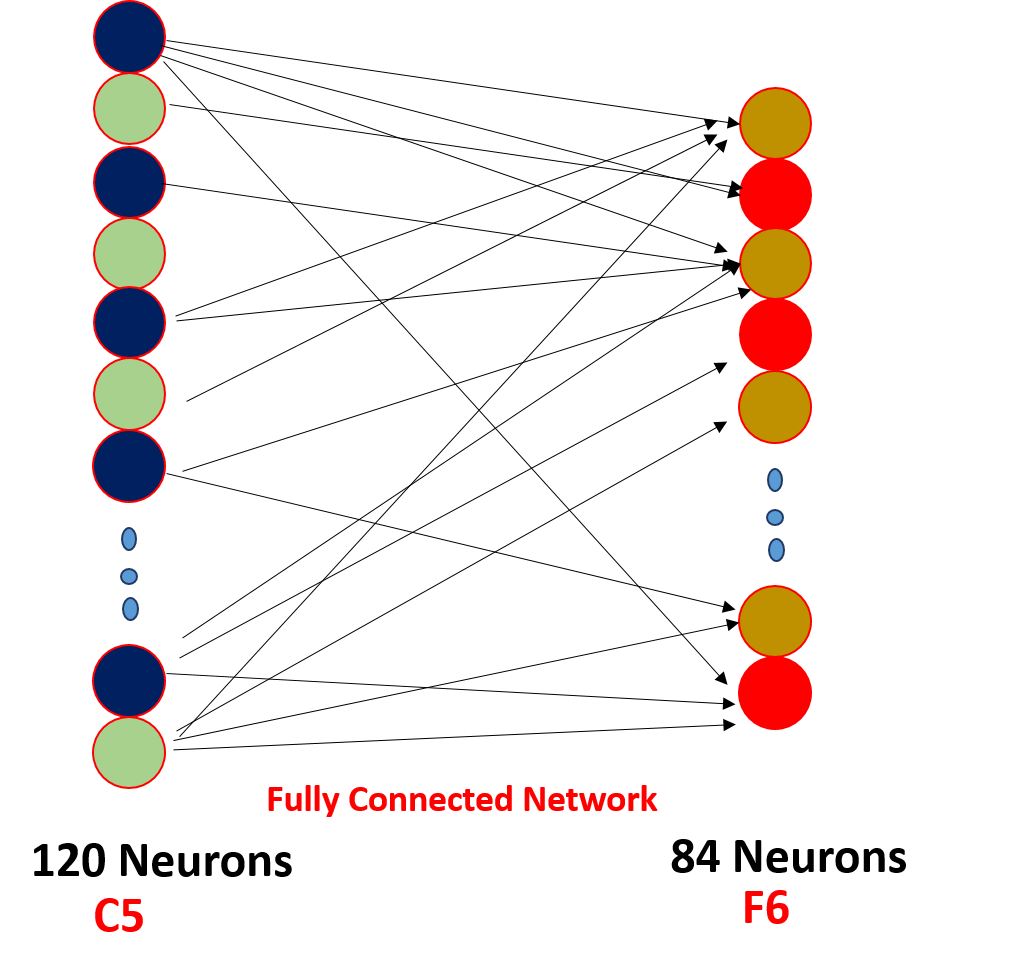

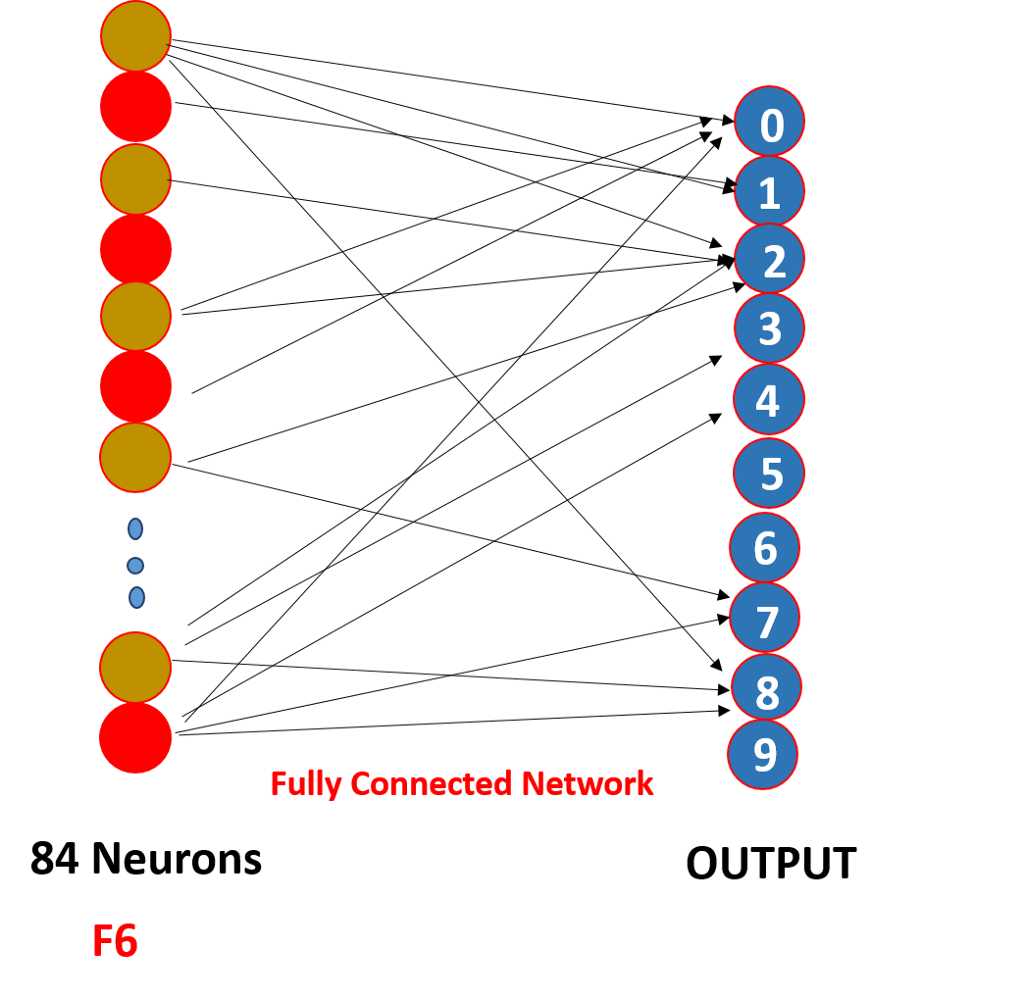

a Konečně, my zploštit všechny 5 x 5 x 16 na jedné vrstvě o velikosti 400 hodnot je vkládat je do feed-forward neural network 120 neurony mají hmotnost matrice a velikost skryté vrstvy 84 neurony spojeny 120 neurony s hmotností matice a tyto 84 neurony skutečně připojeni do 10 výstupních neuronů

Tyto o/p neurony dokončit předpokládaný počet o softmaxing .,

jak funguje konvoluční neuronová síť?,

To funguje přes váhu sdílení a řídké připojení,

.png)

Tak tady, jak můžete vidět konvoluce má nějaké závaží tyto váhy jsou sdíleny všechny vstupní neurony, ne každý vstup má samostatný hmotnosti se nazývá hmotnosti sdílení, a ne všechny vstupní neurony jsou připojeny na výstup neuronu na ‚ o ‚ jen některé, které jsou spletité jsou vypalovány známý jako řídké připojení, CNN se neliší od feed-forward neural networks tyto dvě vlastnosti, aby jim zvláštní !!!,

ukazuje na

1. Po každém konvoluce výstup je zaslán aktivační funkce tak, aby se získat lepší vlastnosti a zachování pozitivity např: ReLu

2. Řídká konektivita a sdílení hmotnosti jsou hlavním důvodem, proč konvoluční neuronová síť funguje

3. Koncept výběru počet filtrů v mezi vrstvami a polstrování a krok a filtr rozměry jsou přijímána na řadu experimenty, o to se neboj, zaměřit se na budování nadace, a to jednou budeš dělat ty pokusy, a vytvořit více produktivní!!!,

tento článek si můžete také přečíst v naší mobilní aplikaci