Hva er Convolutional Nevrale Nettverk Arkitektur?

Denne artikkelen ble publisert som en del av Data, Science Blogathon.

Innledning

å Jobbe på et Prosjekt på bildet for anerkjennelse eller Objekt Deteksjon, men som ikke har de grunnleggende for å bygge en arkitektur?,

I denne artikkelen vil vi se hva som er convolutional nevrale nettverk arkitekturer rett fra grunnleggende og vi vil ta en grunnleggende arkitektur som en case-studie for å bruke vår erfaringene, Den eneste forutsetning er at du trenger bare å vite hvordan ferdige verk, Men ikke bekymre deg, det er veldig enkelt !!

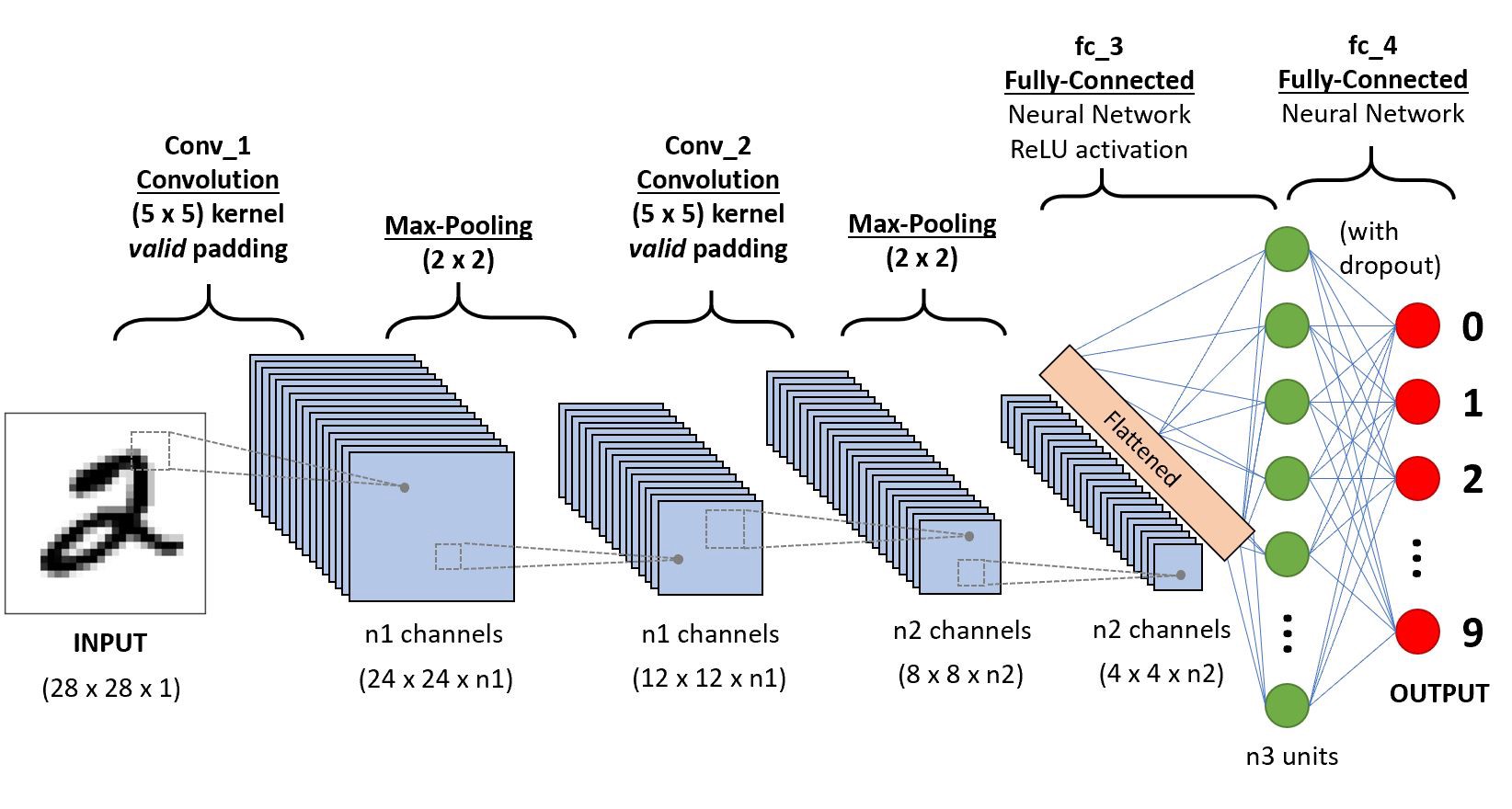

La oss ta et enkelt Convolutional nevrale nettverk,

Vi vil gå lag-klokt å få dyp innsikt om denne CNN.,

Først, er det et par ting å lære fra lag 1, som er striding og polstring, vi vil se hver enkelt av dem i korte trekk med eksempler

La oss anta dette i input matrise av 5×5 og et filter av 3X3 matrise, for de som ikke vet hva et filter er et sett av vekter i en matrise brukt på et bilde eller en matrise for å få den nødvendige funksjoner, vennligst søk på foldning hvis dette er første gang!

Merk: Vi tar alltid summen eller gjennomsnittet av alle verdiene mens du gjør en foldning.,

Et filter kan være av hvilken som helst dybde, hvis filteret er å ha en dybde d det kan gå til en dybde av d-lag og convolute jeg.,»f4a6da248a»>

Her inngangen er av størrelse 5×5 etter å ha brukt en 3×3-kjernen eller filtre du får en 3×3-utgang-funksjon kart så la oss prøve å formulere dette

.png)

Så output høyde er formulert, og det samme med o/p bredde også…

Fyll

når du søker convolutions vi vil ikke få utgang dimensjoner samme som input vi vil miste data over landegrensene, slik vi legge til en ramme av nuller og legger det ferdige dekket alle input-verdier.,r bredde også

Striding

Noen ganger vi ønsker ikke å fange opp alle dataene eller informasjonen som er tilgjengelig, så vi hopper noen nærliggende celler la oss visualisere det,

Her input matrise eller bilde er av dimensjoner 5×5 med et filter på 3×3 og en skrittlengde på 2, slik at hver gang vi hoppe over to kolonner og convolute, la oss formulere dette

.png)

Hvis mål er i flyte du kan ta ceil() på output jeg.,e (neste nær heltall)

Her H refererer til høyden, så output høyde er formulert, og det samme med o/p bredde også, og her er 2 steg verdien, slik at du kan gjøre det så S i formler.

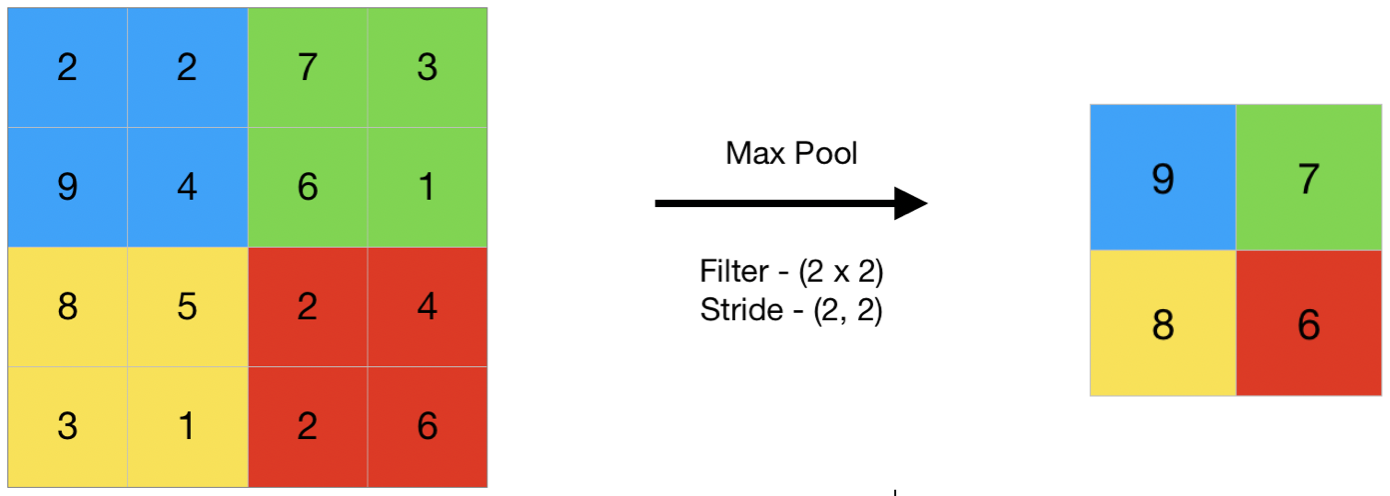

Føre

I de generelle vilkår pooling refererer til en liten del, så her tar vi en liten del av input og prøve å ta den gjennomsnittlige verdien referert til som gjennomsnittlig pooling eller ta en maksimal verdi betegnet som maks utvalg, så ved å gjøre å samle på et bilde vi ikke tar ut alle verdiene tar vi en oppsummert verdi over alle verdiene til stede !!!,

her er et eksempel på maks samle så her for du tar et steg av to vi tar den maksimale verdien som er til stede i matrix

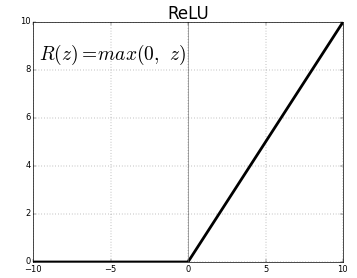

Aktivering av funksjon

Aktivering funksjonen er en node som er satt i enden av eller i mellom Nevrale Nettverk. De hjelper til å avgjøre om nevron ville brann eller ikke., Vi har forskjellige typer aktivisering funksjoner akkurat som i figuren ovenfor, men for dette innlegget, mitt fokus vil være Rettet Lineær Enhet (ReLU)

ikke slippe din kjefter, dette er ikke at komplekse denne funksjonen bare returnerer 0 hvis verdien er negativ ellers returnerer den samme verdien som du ga, ingenting, men eliminerer negative utganger og opprettholder verdier mellom 0 til +uendelig

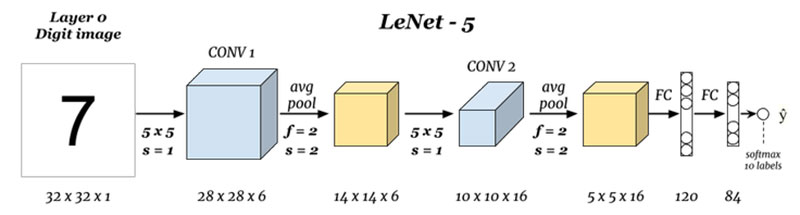

Nå, at vi har lært alt det grunnleggende som trengs la oss studere et grunnleggende nevrale nettet kalt LeNet.,

LeNet-5

Før du begynner vi vil se hva som er arkitekturer laget til dags dato.,ures

Hva er innganger og utganger (Lag 0 Lag N) :

Her har vi spår sifre basert på input bilde gitt, merk at det her bildet er av dimensjoner høyde = 32 punkter, bredde = 32 piksler, og en dybde på 1, så vi kan anta at det er en gråskala eller en svart og en hvit, holde det i tankene utgang er en softmax av alle de 10 verdier, her softmax gir sannsynligheter eller rater for alle 10 sifre, kan vi ta det antall som output med høyeste sannsynlighet eller forhold.,ef5″>

Her tar vi inn-og convoluting med filter av størrelse 5 x 5 dermed produsere en effekt av størrelse 28 x 28 sjekk formelen ovenfor til å beregne utgang dimensjoner, er det ting her er at vi har tatt 6 slike filtre, og derfor dybden av conv1 er 6, derav dens mål var, 28 x 28 x 6 nå sende dette til sammenføring lag

Pooling 1 (Lag 2) :

.png)

Her har vi tar 28 x 28 x 6 som input og anvende gjennomsnittlig pooling av en matrise på 2×2 og et hopp til 2 jeg.,e svever en 2 x 2 matrise på input og å ta gjennomsnittet av alle de fire punkter og hoppe med et hopp på 2 kolonner hver gang og dermed gir 14 x 14 x 6 som output vi computing sammenføring for alle lag, så her er det utgang dyp er 6

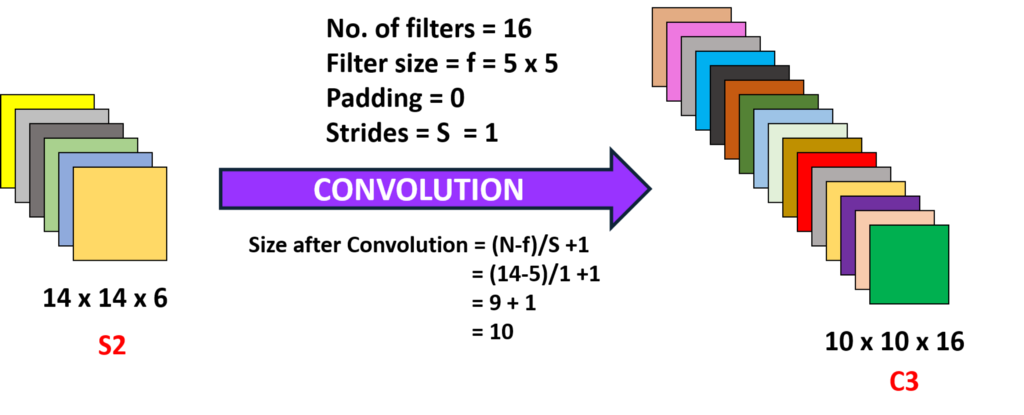

Foldning 2 (Lag 3) :

Her har vi tar 14 x 14 x 6 jeg.e forrige o/p og convoluting med et filter av størrelse 5 x5, med et hopp på 1 jeg.,e (uten skip), og med null polstring, slik at vi får en 10 x 10-utgang, nå her vi tar 16 slike filtre av dybde 6 og convoluting dermed å oppnå en effekt på 10 x 10 x 16

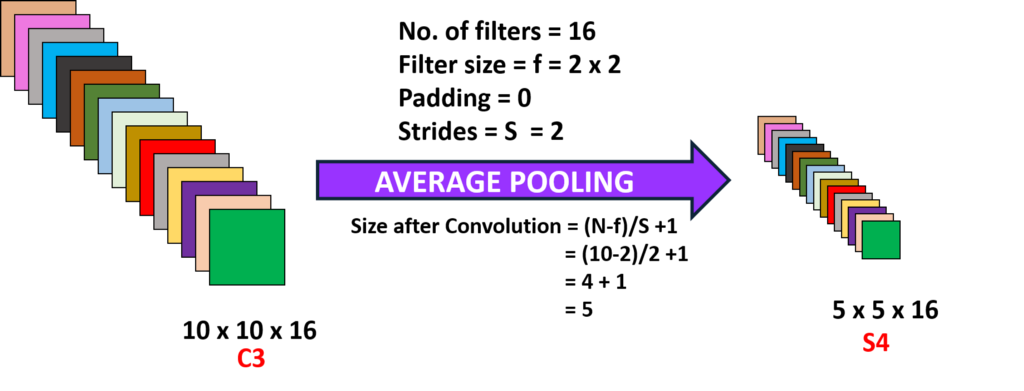

Pooling 2 (Lag 4):

Her har vi tar resultatet av den forrige lag og utføre gjennomsnittlig sammenslåing med et hopp på 2 jeg.,yer (N-1) :

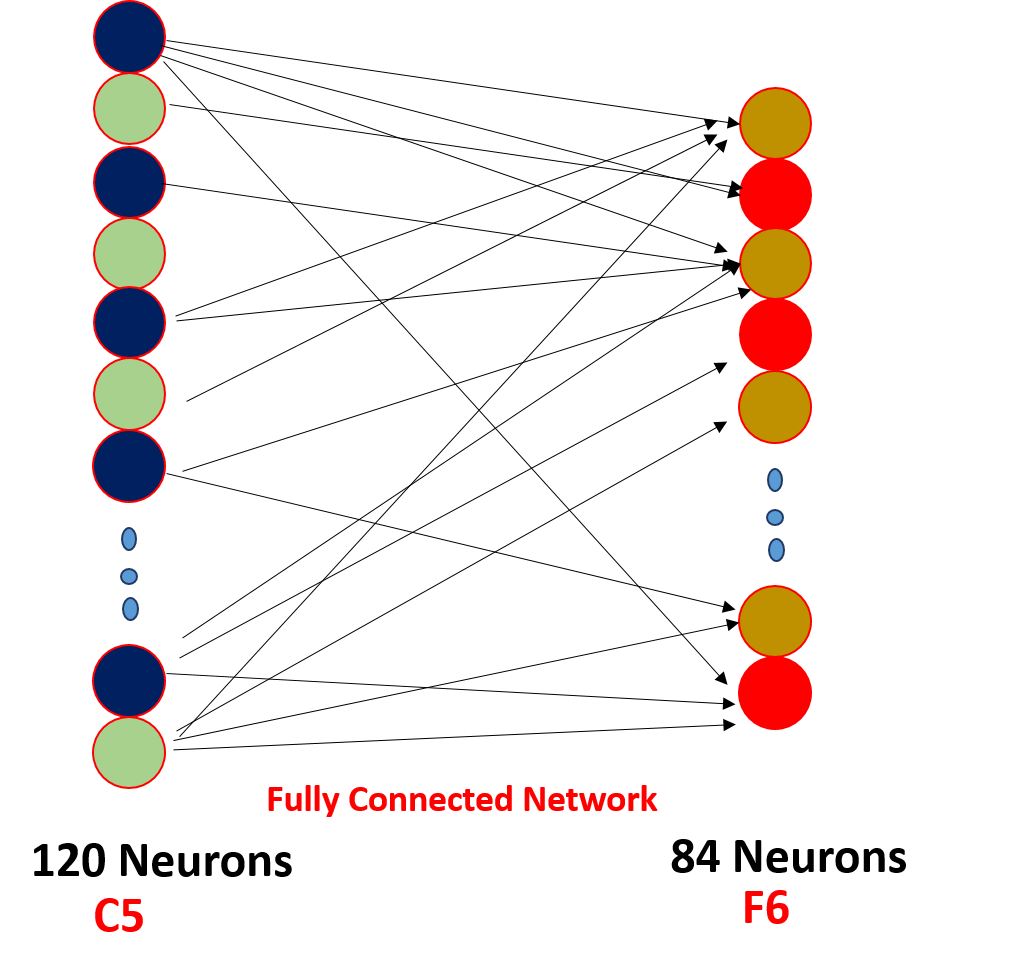

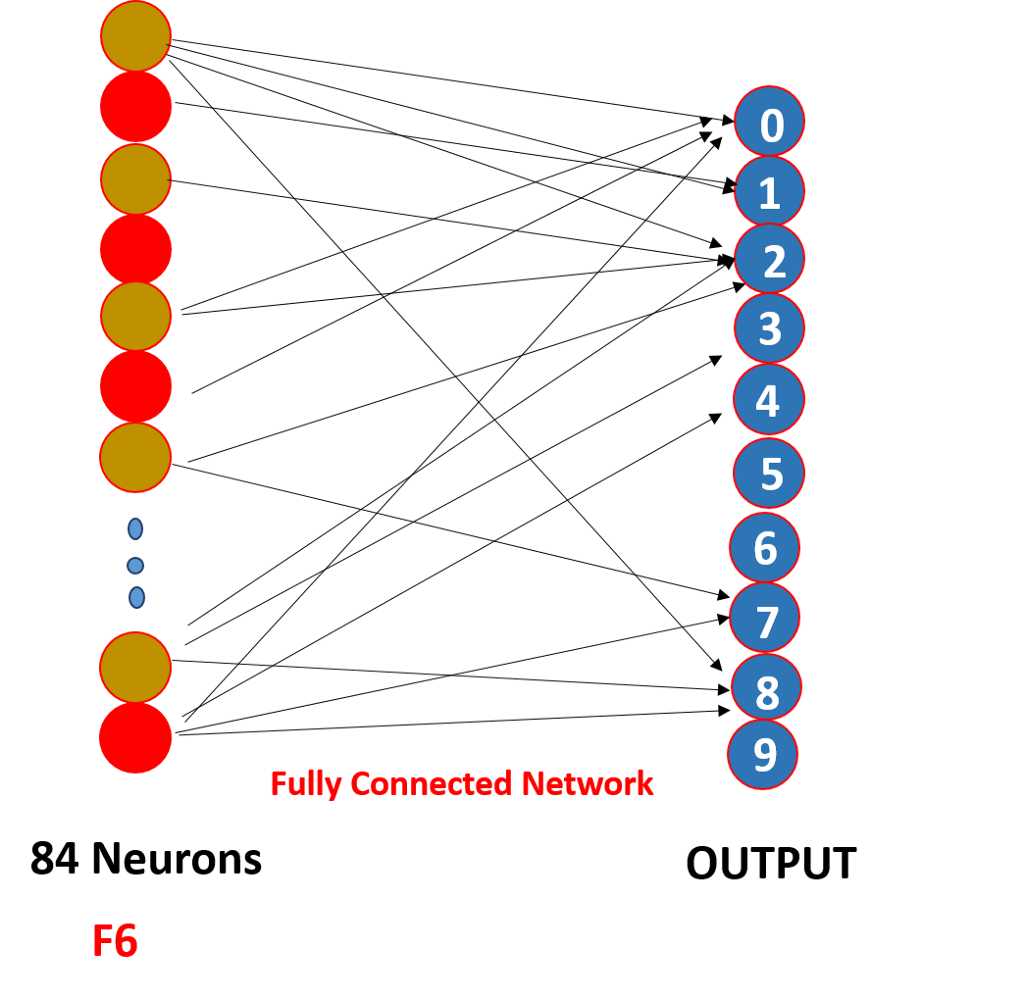

til Slutt, vi slår sammen alle 5 x 5 x 16 til et enkelt lag av størrelse 400 verdier en sende dem til en feed-forward nevrale nettverk av 120 neurons å ha en vekt matrise av størrelse og skjulte laget av 84 nerveceller som er forbundet med 120 nevroner med en vekt matrise av disse 84 nevroner faktisk er koblet til en 10-utgang nevroner

Disse o/p nevroner sluttføre spådd nummeret av softmaxing .,

Hvordan virker en Convolutional Nevrale Nettverk fungerer faktisk?,

Det fungerer gjennom vekt deling og sparsom tilkobling,

.png)

Så her så kan du se det ferdige har noen vekter disse vektene er felles for alle innspill nevroner, ikke hver inngang har en egen vekt kalt vekt deling, og ikke alle innspill nevroner er koblet til utgang nevron en ‘ o er det bare noen som er convoluted er avfyrt kjent som sparsom tilkobling, CNN er ikke forskjellig fra feed-forward nevrale nettverk disse to egenskaper som gjør dem spesielt !!!,

Poeng å se på

1. Etter hvert ferdige resultatet er sendt til en aktivering av funksjon, slik som å få bedre funksjoner og vedlikeholde positivitet f.eks: ReLu

2. Enkel tilkobling og vekt deling er den viktigste grunnen for en convolutional nevrale nettverk til å fungere

3. Konseptet av å velge en rekke filtre i mellom lagene og polstring og skrittlengde og filter dimensjoner blir tatt med på å gjøre et nummer av experimentations, ikke bekymre deg om det, fokusere på å bygge foundation, en dag vil du gjøre slike eksperimenter og bygge en mer produktiv en!!!,

Du kan også lese denne artikkelen om vår Mobil-APP